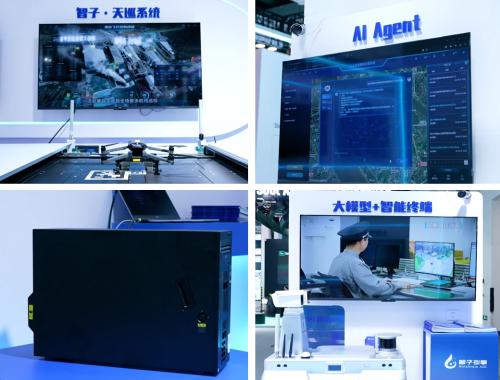

智子引擎与Awaker模型惊艳WAIC 2024 人工智能应用软件开发迎来新纪元

在刚刚拉开帷幕的2024世界人工智能大会上,一场来自前沿技术的震撼首秀,正在重新定义人工智能应用软件开发的未来图景。备受瞩目的“智子引擎”正式亮相,而其核心驱动力量——Awaker多模态大模型系列产品的惊艳登场,更是将大会的气氛推向高潮。这不仅是一场产品的发布,更昭示着AI应用开发范式的一次深刻变革。

智子引擎,作为一套全新的人工智能应用开发与部署平台,其设计初衷直指当前AI软件开发的痛点:高门槛、长周期与复杂的集成工作。它旨在为开发者提供一个“开箱即用”的强大工具箱,将底层复杂的模型训练、优化和算力调度封装起来,让开发者能够更专注于业务逻辑与创新应用本身。而Awaker多模态大模型,正是这个引擎最强大的“心脏”。

本次首秀的Awaker系列模型,其“惊艳”之处在于它真正实现了对文本、图像、音频、视频乃至3D信息的深度融合理解与生成。与以往单一模态的模型不同,Awaker能够像人类一样,综合多种感官信息进行推理和创作。例如,它可以观看一段产品演示视频,理解其功能,并自动生成详细的产品说明书、营销文案,甚至设计对应的广告海报。这种跨模态的协同能力,为应用开发打开了前所未有的想象空间。

对于人工智能应用软件开发领域而言,智子引擎与Awaker的结合,意味着三大趋势的加速到来:

第一,开发民主化与效率革命。 传统上,开发一个功能完善的AI应用需要组建涵盖算法、工程、数据等领域的专业团队。现在,借助智子引擎提供的标准化接口和预置模型能力,一个小的产品团队甚至个人开发者,都能快速构建出具备复杂多模态交互能力的应用原型。开发周期从数月缩短至数周甚至数天,极大地激发了创新活力。

第二,应用场景的深度融合与拓展。 Awaker的多模态能力,使得AI应用能够无缝融入更广阔、更自然的场景。在教育领域,可以开发出能“看懂”学生解题步骤并“听出”其疑惑点,从而提供个性化辅导的智能助教;在工业质检中,系统可以同时分析产品外观图像、生产线声音频谱和振动数据,实现更精准的缺陷检测;在内容创作领域,一句话或一张草图就能生成包含文案、配音、画面的完整短视频。应用软件的边界被极大地拓宽。

第三,人机交互的自然化与智能化。 未来的AI应用软件将不再是机械地执行单一指令。基于多模态理解,软件能够更准确地捕捉用户的意图和上下文。例如,在会议软件中,系统不仅能转录文字,还能通过分析发言者的语气和表情,自动提炼出会议的情绪基调和关键决策点;在设计软件中,设计师用自然语言结合手势比划,就能实时调整3D模型。人机交互正从“输入-输出”模式向“协同-共创”模式演进。

这场变革也伴随着新的挑战。多模态大模型对算力提出了更高要求,如何通过智子引擎实现高效、低成本的推理部署是关键。数据隐私、生成内容的可靠性以及伦理对齐等问题,也需要在平台设计和应用开发中被置于优先地位。

2024年世界人工智能大会上的这次惊艳首秀,无疑是一个清晰的信号:以智子引擎和Awaker为代表的新一代AI基础设施和核心模型,正在为人工智能应用软件开发铺就一条高速轨道。开发者的创造力将得到极大释放,各行各业的数字化转型将拥有更智能、更融合的利器。人工智能不再仅仅是遥不可及的前沿科技,而是即将化为千万个触手可及、赋能百业的智能应用,深刻重塑我们的工作与生活。一个由AI原生应用驱动的新时代,已然拉开序幕。

如若转载,请注明出处:http://www.saic-lab.com/product/36.html

更新时间:2026-02-25 09:17:11